Wie die EU KI-generierte Inhalte erkennbar machen will – und warum das mehr ist als ein Deepfake-Label

Der zweite Entwurf des Code of Practice ist hier abrufbar:

https://digital-strategy.ec.europa.eu/en/library/commission-publishes-second-draft-code-practice-marking-and-labelling-ai-generated-content

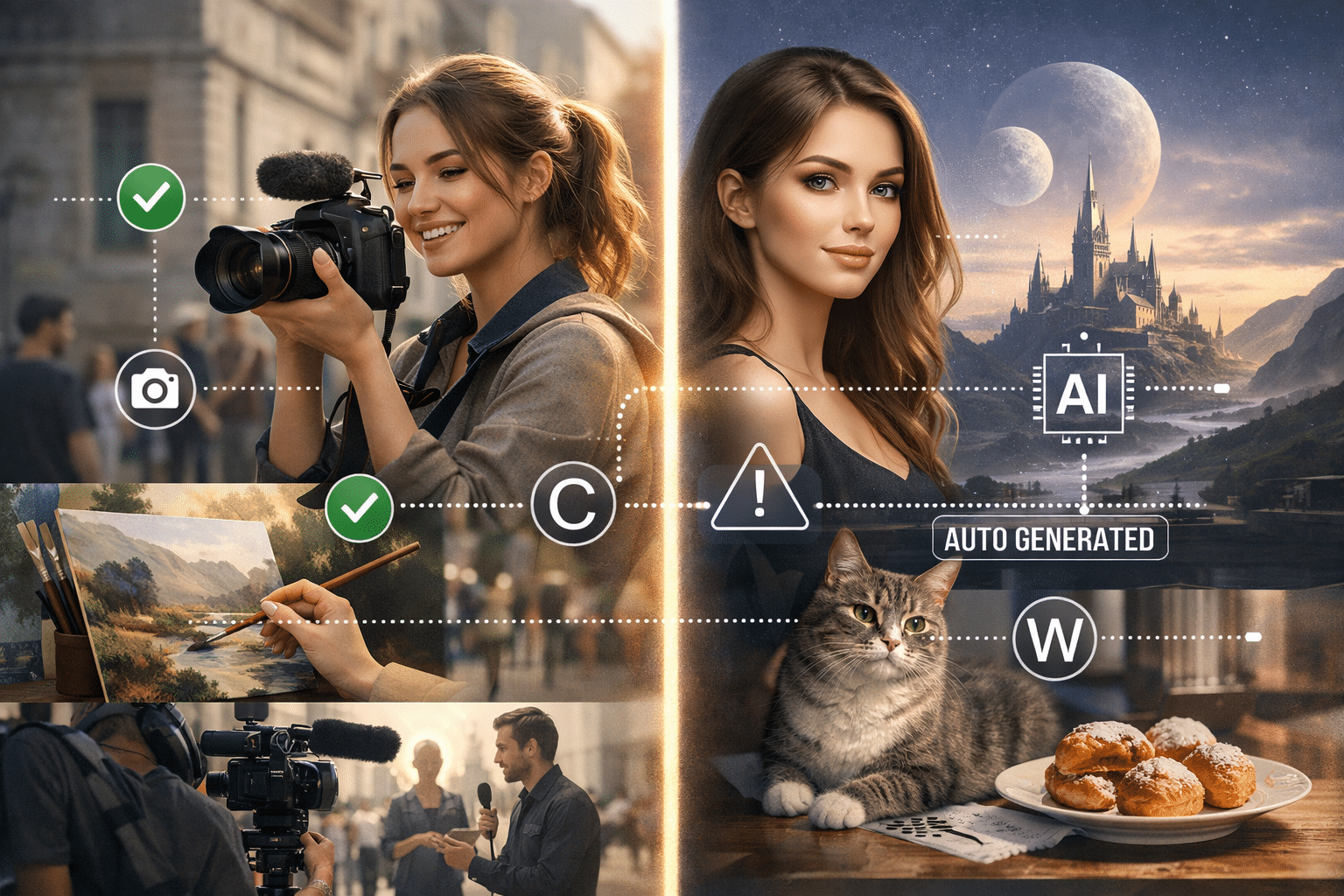

Die EU arbeitet an einem Code of Practice zur Kennzeichnung von KI-generierten Inhalten. Der kürzlich veröffentlichte zweite Entwurf ist noch kein verbindlicher Standard, zeigt aber deutlich die Richtung: Inhalte, die von KI erzeugt oder verändert wurden, sollen technisch nachvollziehbar markiert werden.

Der Entwurf unterscheidet zwei Ebenen.

Erstens die Anbieter generativer KI-Systeme: Sie sollen Ausgaben ihrer Systeme maschinenlesbar kennzeichnen.

Zweitens diejenigen, die solche Inhalte veröffentlichen: Bestimmte Inhalte müssen gegenüber dem Publikum sichtbar als KI-generiert oder -verändert gekennzeichnet werden. Damit trennt der Entwurf klar zwischen technischer Herkunftsmarkierung im Hintergrund und einer sichtbaren Kennzeichnung für Nutzer.

Mehrschichtige Kennzeichnung

Da keine einzelne Technik derzeit ausreichend robust ist, setzt der Entwurf auf mehrere Schichten.

Die wichtigste Ebene sind digital signierte Metadaten. Wenn ein Dateiformat dies erlaubt, sollen dort Informationen hinterlegt werden, ob und wie ein Inhalt mit KI erzeugt oder verändert wurde, versehen mit Kennnummer, Zeitstempel und Signatur. Für Textformate ohne solche Metadaten ist ein Herkunftszertifikat vorgesehen.

Als zweite Ebene dienen unsichtbare Wasserzeichen direkt im Inhalt. Sie sollen erhalten bleiben, auch wenn Metadaten entfernt wurden. Für Audio, Bild und Video ist zusätzlich ein öffentlich auslesbares Wasserzeichen vorgesehen, das etwa auf eine Prüfstelle oder Kennnummer verweist.

Optional können Fingerprinting oder Protokollierung hinzukommen, etwa bei Texten. Gleichzeitig nennt der Entwurf ausdrücklich Grenzen: Datenschutz, journalistischer Quellenschutz, redaktionelle Unabhängigkeit und Medienfreiheit sollen gewahrt bleiben.

Transparenz als Infrastruktur

Ein zentraler Punkt: Kennzeichnung soll nicht nur existieren, sondern auch überprüfbar sein. Anbieter sollen kostenlose Werkzeuge oder Schnittstellen bereitstellen, mit denen Plattformen, Medien, Behörden oder Nutzer prüfen können, ob Inhalte aus ihrem System stammen.

Damit entsteht mehr als nur ein Wasserzeichen. Der Entwurf zielt auf eine technische Infrastruktur zur Herkunftsprüfung: gemeinsame Standards, Prüfdienste, offene Prüfregeln und möglicherweise sogar europäische Prüfschnittstellen.

Sichtbare Kennzeichnung

Parallel dazu sieht der Entwurf eine zweite Ebene vor: eine sichtbare Offenlegung gegenüber dem Publikum. Deepfakes oder bestimmte KI-generierte Inhalte zu Themen von öffentlichem Interesse sollen klar gekennzeichnet werden, möglicherweise über ein einheitliches EU-Symbol.

Für künstlerische, satirische oder fiktionale Werke sollen flexiblere Lösungen gelten, um kreative Ausdrucksformen nicht unnötig zu beeinträchtigen.

Die offene Frage: mögliche Ausweitung

Formal bezieht sich der Entwurf nur auf KI-generierte oder KI-veränderte Inhalte. Dennoch enthält er Formulierungen, die weiter reichen. Mehrfach wird betont, dass Standards langfristig die gesamte Entstehungs- und Bearbeitungskette digitaler Inhalte abbilden könnten – auch in Arbeitsabläufen, in denen Menschen und KI gemeinsam arbeiten.

Technisch entsteht damit eine Struktur aus Kennnummern, Prüfdiensten und Herkunftsnachweisen. Sie dient zunächst dazu, KI-Ursprung zu erkennen, könnte aber grundsätzlich auch genutzt werden, um die Entstehung digitaler Inhalte allgemein nachvollziehbar zu machen.

Fazit

Der Entwurf des Code of Practice ist weit mehr als eine Anleitung zur Deepfake-Kennzeichnung. Er skizziert eine mehrschichtige Infrastruktur aus Metadaten, Wasserzeichen und Prüfdiensten, mit der sich Herkunftsinformationen digitaler Inhalte überprüfen lassen.

Die politische Kernfrage lautet daher nicht nur: Wie markieren wir KI-Inhalte?

Sondern auch: Wollen wir einen Informationsraum, in dem die Herkunft digitaler Inhalte technisch nachvollziehbar wird? Und was bedeutet das für Anonymität und Kommunikationsfreiheit?

Noch sehe ich keine konkrete Bedrohung. Aber lasst uns ein Auge darauf haben…

Offenlegung: Dieser Text wurde mit KI-Hilfe formuliert und lektoriert. Dennoch spiegelt er die Meinung eines Menschen wider.

- Über den Autor

- Artikel

Vizepräsident der Digital Society. Fan der direkten Demokratie. Professionelle i-Tüpfelreiterei und Besserwisserei. Sicherheitsexpertisen. Open-Source-Entwicklung. Physik. Jus-Studium. Home-Office-Worker. he/him

Neueste Kommentare